Maak een account op Bitvavo en krijg 10 XRP gratis!

Bitvavo: Ontvang 10

XRP Welkomstbonus!

Prominente taalmodellen, zoals OpenAI’s GPT-4 en Google’s Bard, voldoen niet aan de kunstmatige intelligentie (AI)-wetgeving van de Europese Unie (EU). Dit blijkt uit een nieuw onderzoek dat uitgevoerd is door de Stanford University. Deze bevindingen benadrukken het gebrek aan transparantie en naleving van voorschriften, en de potentiële impact van de Europese AI-regelgeving op de industrie. Transparantie wordt steeds meer erkend als essentiële basis voor een verantwoorde toepassing van AI.

In het recente onderzoekt zijn zowel OpenAI’s GPT-4 als Google’s Bard genadeloos bekritiseerd door de onderzoekers. De conclusie luidt dat geen enkel van deze prominente taalmodellen momenteel voldoet aan de voorschriften uiteengezet in de ‘Wet Kunstmatige Intelligentie (AI)’ van de Europese Unie (EU).

Deze baanbrekende wetgeving, de eerste in haar soort om AI op zowel nationaal als regionaal niveau te reguleren, is onlangs unaniem aangenomen door het Europees Parlement. De EU AI Act beperkt zich niet alleen tot het reguleren van AI binnen de EU, met een bevolking van circa 450 miljoen mensen, maar fungeert tevens als een vooruitstrevende blauwdruk voor wereldwijde AI-regelgeving.

Desalniettemin, volgens het recente onderzoek van Stanford, hebben AI-bedrijven nog aanzienlijke vorderingen te maken om te kunnen voldoen aan de wetgeving.

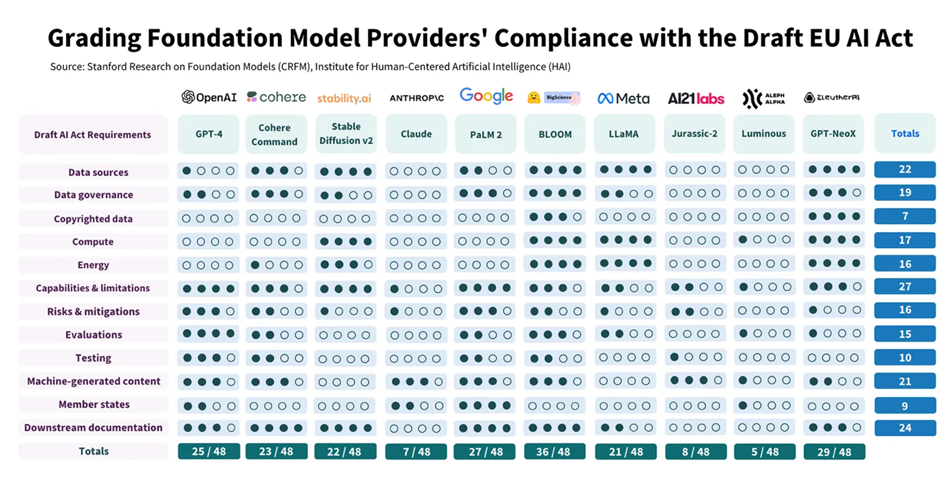

De onderzoekers hebben 10 toonaangevende aanbieders van taalmodellen geëvalueerd in hun studie. Op een schaal van 0 tot 4 werd beoordeeld in welke mate elke aanbieder voldeed aan de 12 vereisten van de AI-wetgeving.

De resultaten onthullen een aanzienlijke discrepantie in de naleving van de wetgeving, waarbij sommige aanbieders niet meer dan 25% scoorden op het gebied van compliance, terwijl slechts één aanbieder, namelijk Hugging Face/BigScience, erin slaagde om een score van meer dan 75% te behalen.

Niettemin blijkt dat zelfs de aanbieders met de hoogste scores nog ruimte hebben voor aanzienlijke verbeteringen.

Het uitgevoerde onderzoek werpt een onthullend licht op diverse cruciale aspecten van niet-naleving. De onderzoekers hebben verontrustende constateringen gedaan met betrekking tot een gebrek aan transparantie bij het openbaar maken van de status van auteursrechtelijk beschermde trainingsgegevens, het energieverbruik, de uitstoot die geproduceerd wordt, en de methodologieën die toegepast worden om potentiële risico’s te beperken.

Bovendien heeft het team een duidelijke ongelijkheid vastgesteld tussen open en gesloten modelreleases. Open releases hebben de neiging om een robuustere openbaarmaking van bronnen mogelijk te maken, maar brengen ook grotere uitdagingen met zich mee op het gebied van monitoring en controle van het gebruik ervan.

De conclusie van Stanford luidt dat eigenlijk alle leveranciers hun gedrag kunnen verbeteren, ongeacht de methode die zij hanteren voor het vrijgeven van hun modellen.

In de afgelopen maanden is er een opmerkelijke afname waargenomen in de mate van transparantie bij grote modelreleases. Zo heeft bijvoorbeeld OpenAI geen informatie verstrekt over de gebruikte gegevens en berekeningen in hun GPT-4-rapporten, onder het argument van een concurrerend landschap en veiligheidsimplicaties.

Alhoewel deze bevindingen van aanzienlijk belang zijn, passen ze ook binnen een bredere context. Onlangs heeft OpenAI zich actief ingezet om de houding van diverse landen ten opzichte van AI te beïnvloeden, wat een niet te verwaarlozen aspect vormt in het licht van deze ontdekkingen. Als vooraanstaande technologiereus heeft OpenAI zelfs gedreigd Europa te verlaten indien de regelgeving omtrent AI te stringent zou worden – een dreigement dat nadien is ingetrokken. Dergelijke acties benadrukken de complexe en vaak delicate relatie tussen aanbieders van AI-technologie en regulerende instanties.

De onderzoekers hebben meerdere aanbevelingen geformuleerd ter verbetering van de regelgeving rondom AI. Met betrekking tot EU-beleidsmakers is het van wezenlijk belang dat de AI-wetgeving leveranciers van grootschalige modelarchitecturen aansprakelijk houdt voor transparantie en verantwoordingsplicht. Daarnaast wordt de noodzaak van technologische middelen en gekwalificeerd personeel benadrukt ter waarborging van de handhaving van deze wetgeving, waarbij de complexiteit van het AI-ecosysteem tot uiting komt.

Volgens de onderzoekers ligt de grootste uitdaging in het vermogen van AI-aanbieders om hun bedrijfspraktijken snel aan te passen en te ontwikkelen om aan de wettelijke vereisten te voldoen. Zonder strikte regelgevingsdruk kunnen vele aanbieders naar behoren hoge scores behalen – ergens tussen de 30 en 40 punten op een schaal van 48 – door middel van zinvolle, doch plausibele wijzigingen.

Het werk van de onderzoekers biedt een diepgaand inzicht in de toekomst van AI-regulering. Zij stellen dat de implementatie en handhaving van de AI-wetgeving een aanzienlijke positieve invloed zal uitoefenen op het ecosysteem en een weg zal banen naar meer transparantie en verantwoordingsplicht.

AI transformeert de maatschappij met zijn ongekende mogelijkheden en inherente risico’s. Nu de wereld op het punt staat deze baanbrekende technologie te reguleren, wordt steeds duidelijker dat transparantie niet louter een optionele toevoeging is, maar een essentiële grondslag vormt voor een verantwoorde toepassing van AI.

De Fed staat voor een onmogelijke keuze: inflatie van 3,5 procent accepteren of de rente verhogen en massawerkloosheid riskeren. Beide opties zijn pijnlijk.

Vietnamese autoriteiten arresteren verdachten achter cryptoplatform ONUS voor miljardenfraude. Het netwerk manipuleerde tokenprijzen en misleidde miljoenen beleggers met valse reclame.

De Britse overheid heeft sancties opgelegd aan Xinbi, een Chinese cryptomarktplaats met een geschatte waarde van 20 miljard dollar.

De Federal Reserve houdt de rente gelijk terwijl inflatiezorgen en geopolitieke spanningen toenemen. Bitcoin maakt onverwacht sprongetje.

Iran overweegt beperkte doorgang door de Straat van Hormuz, maar koppelt dat volgens media aan een opvallende eis rond betalingen in yuan.

Warren Buffett verdient miljarden met olie. Zijn strategie toont waarom spreiding beleggers beschermt tegen onverwachte marktschokken.